L’IA agentica introduce metodologie avanzate per potenziare i meccanismi di rilevamento delle minacce, la risposta agli incidenti e la protezione degli stessi sistemi di intelligenza artificiale.

Questo progresso implica la necessità di una trasformazione radicale nelle architetture e nei principi di base che regolano l’ecosistema della cyber security.

È bene evidenziare che l’IA agentica introduce metodologie avanzate per potenziare: i meccanismi di rilevamento delle minacce; la risposta agli incidenti; la protezione degli stessi sistemi di IA.

Indice degli argomenti

Vantaggi scaturiti dall’integrazione dell’IA agentica nella cyber security

L’integrazione dell’IA agentica nella cyber security rappresenta un cambio di paradigma nella difesa delle infrastrutture digitali. Di fatto, a differenza dei sistemi tradizionali – basati su regole statiche – gli agenti IA operano con un livello di autonomia che consente loro di adattarsi dinamicamente alle minacce emergenti.

Tali sistemi possono analizzare continuamente vasti flussi di dati provenienti da endpoint, reti e applicazioni, identificando pattern anomali che sfuggirebbero all’occhio umano o agli strumenti convenzionali.

Inoltre, la capacità di apprendere dal contesto e dalle interazioni precedenti permette all’IA agentica di affinare costantemente le proprie strategie difensive, riducendo progressivamente i falsi positivi e aumentando la precisione nel rilevamento delle minacce reali.

Ancora, la scalabilità operativa che questi sistemi offrono permette ai team di sicurezza tradizionali di tenere il passo con l’espansione delle superfici di attacco moderne, dato che gli agenti IA possono monitorare simultaneamente migliaia di asset distribuiti geograficamente, orchestrando risposte coordinate, senza l’intervento umano diretto.

Ovvero siamo dinanzi ad un approccio proattivo che trasforma la cyber security da una disciplina prevalentemente reattiva a una strategia anticipatoria, dove le vulnerabilità vengono identificate e mitigate, prima che possano essere sfruttate.

Di fatto, l’automazione intelligente, non solo accelera i tempi di risposta, ma libera anche risorse umane qualificate da compiti ripetitivi, permettendo loro di concentrarsi su attività strategiche e investigazioni complesse che richiedono intuizione e creatività.

Esempi concreti di IA agentica nella cyber security

Di seguito alcuni esempi concreti dell’impiego dell’IA agentica nella cyber security.

Agenti autonomi di risposta agli incidenti

Alcune piattaforme di sicurezza ora includono agenti di intelligenza artificiale in grado di indagare in modo indipendente ed eseguire funzioni di rilevamento e risposta alle minacce. Ad esempio, dopo aver individuato un movimento laterale sospetto in una rete, l’IA agentica potrebbe:

- Avviare la propria indagine, estraendo i registri e verificando le attività correlate.

- Correlare i segnali tra i sistemi per confermare la portata del compromesso.

- Isolare automaticamente gli endpoint interessati, bloccare gli IP dannosi e avvisare gli analisti.

La risposta autonoma implementata dall’IA Agentica consente una significativa riduzione del tempo di permanenza della minaccia e un’accelerazione delle operazioni di contenimento delle minacce, risultando particolarmente efficace nei contesti in cui la capacità di intervento degli analisti umani risulta saturata o insufficiente.

Mitigazione del phishing basata sull’IA

L’IA agentica può anche difendersi da phishing quasi in tempo reale. Di fatto, quando un dipendente clicca su un link sospetto, un sistema agentico potrebbe:

- Ispezionare l’URL, scansionare il sito di destinazione ed effettuare un controllo incrociato con i feed di informazione sulle minacce.

- Controllare se sono state inviate le credenziali o se si sono verificati download.

- Mettere in quarantena retroattivamente l’e-mail, avvisare l’utente, reimpostare le credenziali e adattare le regole di rilevamento per attacchi futuri simili

Correzione degli errori di configurazione del cloud

È doveroso evidenziare che, negli ambienti cloud, configurazioni errate possono creare gravi lacune nella sicurezza.

L’IA agentica può monitorare l’infrastruttura alla ricerca di configurazioni rischiose – quali bucket di storage aperti o policy di gestione delle identità e degli accessi (IAM – Identity & Access management) eccessivamente permissive – e adottare misure per correggerle.

Tali tipi di agenti di IA agiscono come instancabili custodi digitali, analizzando i problemi, oltre ad applicare soluzioni e contribuire a prevenire le derive della sicurezza.

Sfide e considerazioni per l’IA agentica nella cyber security

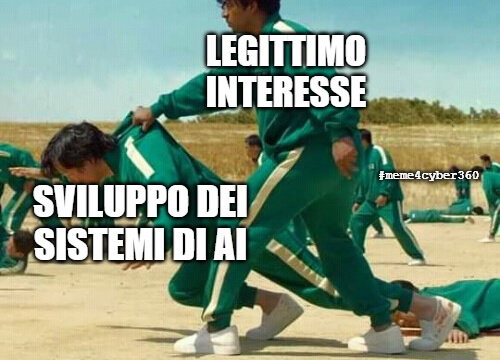

Nonostante i suoi significativi vantaggi, l’uso dell’IA Agentica nella difesa informatica non è privo di sfide e limitazioni. Una delle principali preoccupazioni riguarda la privacy dei dati.

Poiché i sistemi di difesa predittiva dipendono fortemente dai dati, per identificare e modellare le minacce informatiche, devono elaborare grandi volumi di dati sensibili e ciò comporta problemi di privacy.

Inoltre, la gestione impropria o la violazione delle informazioni personali può avere gravi conseguenze, in particolare in settori come quello sanitario o finanziario, dove è obbligatorio rispettare severe leggi sulla protezione dei dati (ad esempio, il GDPR).

Pertanto, garantire che i sistemi di IA rispettino queste normative e non rivelino informazioni riservate, è una caratteristica essenziale per un’implementazione efficace e corretta del sistema.

Un ulteriore elemento critico nell’ambito dell’IA agentica riguarda il rischio di bias nei modelli, poiché i sistemi di difesa predittiva si fondano su algoritmi di machine learning addestrati su dataset storici.

Di conseguenza, qualora i dati di training presentino pattern di parzialità preesistenti (ad esempio, vulnerabilità di sicurezza concentrate su specifiche tipologie di utenti o dispositivi), il modello tenderà a perpetuare tali distorsioni nelle sue decisioni. In particolare, se il sistema viene istruito su dati provenienti da una determinata area geografica o settore di business, potrebbe non rilevare efficacemente minacce emergenti più rilevanti in altri contesti.

Pertanto, è fondamentale garantire un’adeguata eterogeneità sia nei dati di addestramento sia nella progettazione dei modelli di IA, al fine di prevenire soluzioni di sicurezza parziali o non generalizzabili.

Inoltre, l’IA applicata alla sicurezza informatica presenta alcune limitazioni intrinseche, tra cui la generazione di falsi positivi e il rischio di overfitting. Ovvero:

- Falsi positivi: si manifestano quando il sistema classifica erroneamente attività legittime come minacce, attivando allarmi e procedure di risposta non necessari.

- Overfitting: si verifica quando il modello predittivo è eccessivamente specializzato sui dati storici, perdendo così la capacità di riconoscere nuove tipologie di attacchi informatici e riducendo l’efficacia in scenari di minaccia in rapida evoluzione.

Ancora, sebbene l’IA agentica possa risultare altamente efficiente in molteplici contesti, può incontrare criticità in ambienti particolarmente complessi o soggetti a cambiamenti rapidi.

Infine, minacce informatiche in costante evoluzione o variabili imprevedibili possono richiedere l’intervento umano nel processo decisionale, laddove l’automazione non sia sufficiente.

È fondamentale garantire, quindi, un aggiornamento e un monitoraggio continuo dei sistemi predittivi, affinché possano adattarsi efficacemente alle nuove forme di attacco e mantenere la propria efficacia nel tempo, dato che, in assenza di tali attività, i modelli rischiano di diventare obsoleti o meno performanti.

È doveroso evidenziare che l’implementazione dell’IA agentica nella cyber security solleva, altresì, questioni complesse relative alla fiducia e alla verificabilità delle decisioni autonome.

Ad esempio, quando un agente AI adotta misure drastiche – quali l’interruzione di servizi critici per contenere una presunta minaccia – le organizzazioni devono confrontarsi con le conseguenze di un potenziale falso positivo. Inoltre, la “black box” algoritmica – che caratterizza molti modelli di machine learning – rende difficile tracciare retrospettivamente il ragionamento che ha portato a determinate azioni, creando problemi di accountability e di compliance normativa.

Ne consegue che le aziende operanti in settori altamente regolamentati – i.e. settore finanziario o sanitario – potrebbero trovarsi in difficoltà nel giustificare interruzioni operative derivanti da decisioni algoritmiche non completamente trasparenti.

Inoltre, l’introduzione di sistemi di IA agentica avanzata amplia, altresì, la superficie di attacco, poiché gli agenti stessi possono diventare bersagli di attacchi adversarial, in cui attori malevoli manipolano gli input per indurre comportamenti anomali o per addestrare il sistema a ignorare specifiche minacce.

In particolare, il data poisoning rappresenta una vulnerabilità critica: un attaccante, inserendo pattern malevoli durante la fase di training, può creare “backdoor” cognitive che si attivano solo in condizioni precise.

Infine, la dipendenza da infrastrutture cloud – per l’elaborazione di modelli complessi – introduce ulteriori rischi legati alla privacy e alla sovranità dei dati, soprattutto quando informazioni sensibili sulla postura di sicurezza di un’organizzazione sono processate da servizi terzi.

Ne consegue che è essenziale bilanciare l’autonomia operativa dell’IA agentica con una solida supervisione umana per garantire un comportamento sicuro e conforme alle policy.

Il futuro dell’IA agentica nella cyber security: cosa ci attende

L’evoluzione dell’IA agentica nella cyber security è destinata ad orientarsi verso ecosistemi sempre più sofisticati di agenti specializzati che operano in sinergia. Pertanto, i modelli futuri potrebbero incorporare capacità di ragionamento causale, superando l’attuale paradigma correlazionale per comprendere le vere relazioni causa-effetto tra eventi di sicurezza.

Questa transizione – verso sistemi che “comprendono” piuttosto che semplicemente “riconoscono” pattern – permetterebbe previsioni più accurate e maggiori strategie difensive contestualmente appropriate.

Inoltre, l’integrazione con tecnologie emergenti – quali il quantum computing – potrebbe rivoluzionare ulteriormente le capacità sia offensive sia difensive, richiedendo agli agenti IA di adattarsi a paradigmi crittografici completamente nuovi e a velocità di attacco inedite.

Ancora, la dimensione collaborativa si estenderà probabilmente oltre i confini organizzativi, con reti federative di agenti IA che condividono intelligence sulle minacce, preservando al contempo la confidenzialità dei dati sensibili attraverso tecniche come il federated learning.

Di fatto, si tratta di alleanze digitali che potrebbero creare una “immunità di gregge” cibernetica, dove la scoperta di una nuova tecnica di attacco – da parte di un agente – beneficia istantaneamente l’intero ecosistema connesso.

È fondamentale sottolineare che questo futuro interconnesso amplifica anche i rischi sistemici. Ad esempio, un difetto fondamentale in un modello ampiamente adottato potrebbe creare vulnerabilità diffuse sfruttabili su scala globale.

Pertanto, si ritiene che la governance dell’IA agentica diventerà anche una questione geopolitica, richiedendo framework internazionali che stabiliscano standard etici e tecnici per lo sviluppo e l’impiego di agenti autonomi nei domini della sicurezza digitale.

Infine, un’altra sfida – che le organizzazioni dovranno essere in grado di gestire – consiste nel garantire un controllo umano efficace su sistemi di IA agentica, assicurando che la tecnologia agisca come amplificatore dell’intuizione umana, mantenendo trasparenza e supervisione, piuttosto che trasformarsi in un sostituto opaco e difficilmente verificabile.

Conclusione

L’integrazione dell’IA agentica nella cyber security segna un cambio di paradigma epocale: dalla difesa reattiva a quella anticipatoria. Tali sistemi predittivi non si limitano a identificare le minacce in tempo reale, ma orchestrano risposte automatizzate e coordinate, trasformando radicalmente l’approccio alla sicurezza informatica.

Nonostante le sfide ancora aperte – dalla tutela della privacy ai bias algoritmici, fino alla necessità imprescindibile di supervisione umana – i vantaggi dell’IA agentica sono tangibili e strategici. Inoltre, le organizzazioni che adottano questi approcci predittivi acquisiscono capacità senza precedenti in termini di flessibilità operativa, scalabilità e precisione nella rilevazione delle minacce, mantenendo un vantaggio competitivo determinante di fronte a un panorama di attacchi in continua evoluzione.

L’integrazione intelligente di queste tecnologie non rappresenta semplicemente un aggiornamento degli strumenti difensivi esistenti, ma la costruzione di un nuovo modello di sicurezza: più robusto, resiliente e capace di adattarsi dinamicamente alle sfide future.

Un investimento che, in ultima analisi, contribuisce alla sicurezza e alla stabilità dell’intero ecosistema digitale globale.