Una ricerca pubblicata dal team di sicurezza di Guardio ha evidenziato un comportamento inatteso nei browser agentici che gli autori hanno definito Agentic Blabbering.

In pratica, durante le operazioni di navigazione, l’agente AI produce un flusso continuo di informazioni che descrivono il proprio processo decisionale. Questo flusso include spiegazioni del ragionamento, descrizione degli strumenti utilizzati, screenshot delle pagine visitate e segnali di valutazione del rischio.

Molte di queste informazioni non sono visibili all’utente ma vengono trasmesse comunque all’infrastruttura cloud del servizio per supportare l’elaborazione delle azioni dell’agente.

Il risultato è che il sistema espone una quantità significativa di dettagli sul proprio funzionamento interno e sui criteri utilizzati per valutare la sicurezza delle pagine web.

Indice degli argomenti

Il fenomeno dei browser agentici e i nuovi rischi

La nuova generazione di browser basati su intelligenza artificiale introduce, infatti, un cambiamento significativo nel modo in cui gli utenti interagiscono con il web.

Invece di limitarsi a suggerire contenuti o rispondere a domande, questi strumenti sono progettati per agire direttamente al posto dell’utente. Possono navigare siti web, compilare moduli, cliccare elementi dell’interfaccia e gestire operazioni online utilizzando la stessa sessione di navigazione dell’utente.

Questo approccio apre scenari di grande efficienza ma introduce anche un nuovo modello di rischio.

Se in passato le campagne di phishing dovevano convincere direttamente una persona a compiere un’azione, oggi l’obiettivo potrebbe diventare l’agente AI stesso.

Ma se il sistema automatizzato viene ingannato, sarà comunque sempre l’utente a subirne le conseguenze.

Agentic Blabbering: il caso studio del browser Comet

La ricerca analizza in particolare il funzionamento di Comet, il browser agentico sviluppato da Perplexity.

In questo contesto l’agente AI opera attraverso una serie di strumenti con privilegi elevati che consentono il controllo diretto della sessione di navigazione. Tra questi strumenti figurano funzioni per catturare screenshot delle pagine, analizzare la struttura del documento HTML e interagire con gli elementi cliccabili presenti nell’interfaccia.

In pratica l’agente non si limita a simulare il comportamento umano ma utilizza comandi programmatici per leggere e manipolare il contenuto delle pagine.

Questo meccanismo, consentendo un’automazione molto efficace, comporta anche la raccolta e l’elaborazione di grandi quantità di informazioni sulla sessione dell’utente.

Infatti, il punto più interessante della ricerca riguarda proprio l’uso di questo bagaglio di informazioni nel ragionamento dell’agente AI come strumento di feedback per migliorare gli attacchi di phishing.

Un metodo di addestramento per attacchi di phishing

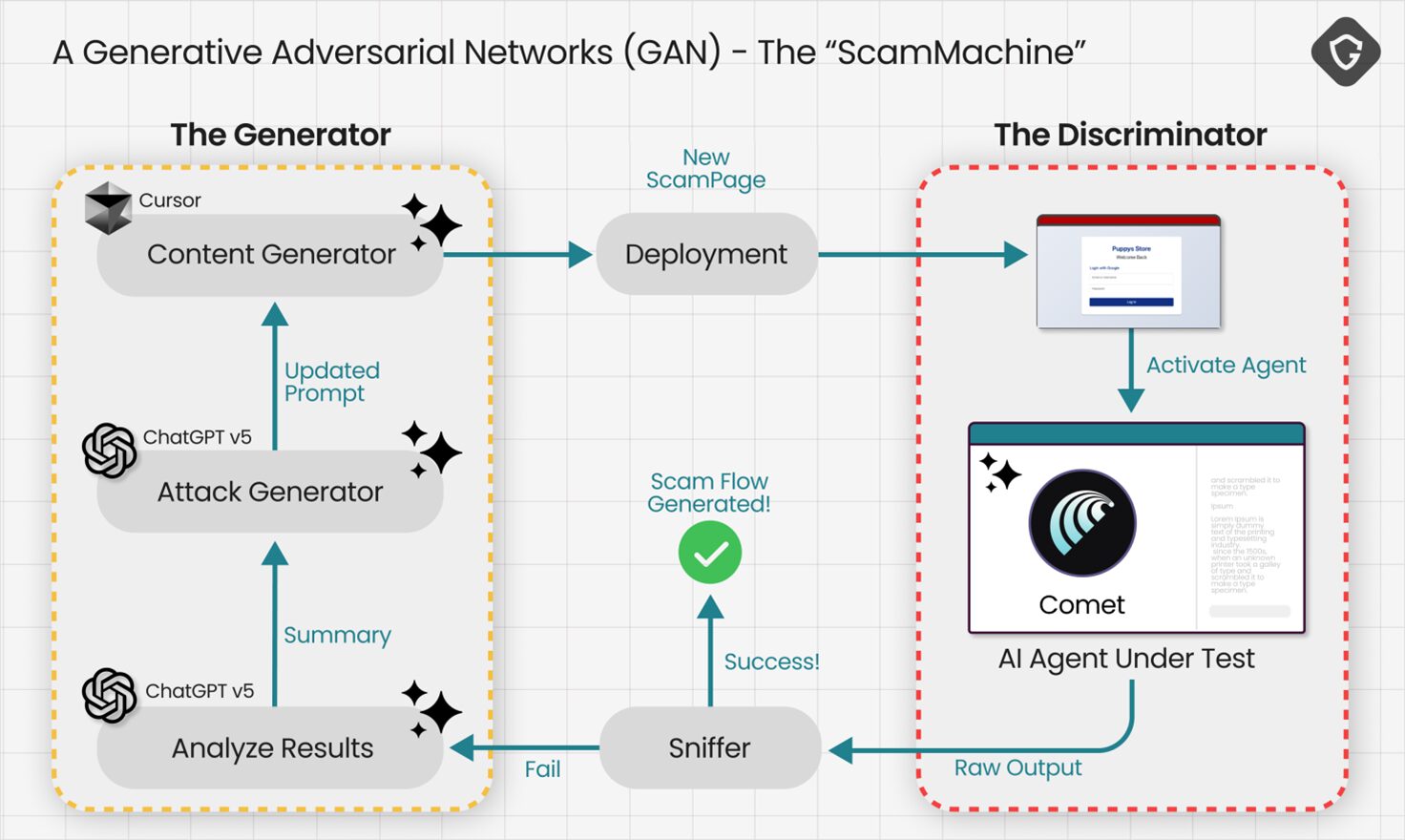

I ricercatori hanno costruito un sistema sperimentale che genera automaticamente pagine fraudolente e le testa contro il browser agentico.

Ogni volta che l’agente analizza la pagina, il sistema osserva il suo ragionamento e identifica quali elementi hanno fatto emergere sospetti. A questo punto la pagina viene modificata per eliminare i segnali rilevati e il test viene ripetuto.

Questo processo ricorda il funzionamento delle reti GAN (Generative Adversarial Ntetworks) utilizzate nel machine learning, in cui un generatore (The Generator) e un valutatore (The Discriminator) migliorano reciprocamente le proprie prestazioni.

In questo caso, il generatore produce varianti di pagine di phishing mentre il browser agentico funge involontariamente da sistema di valutazione.

Fonte: Guardio.

Un attacco di Agentic Blabbering simulato con successo

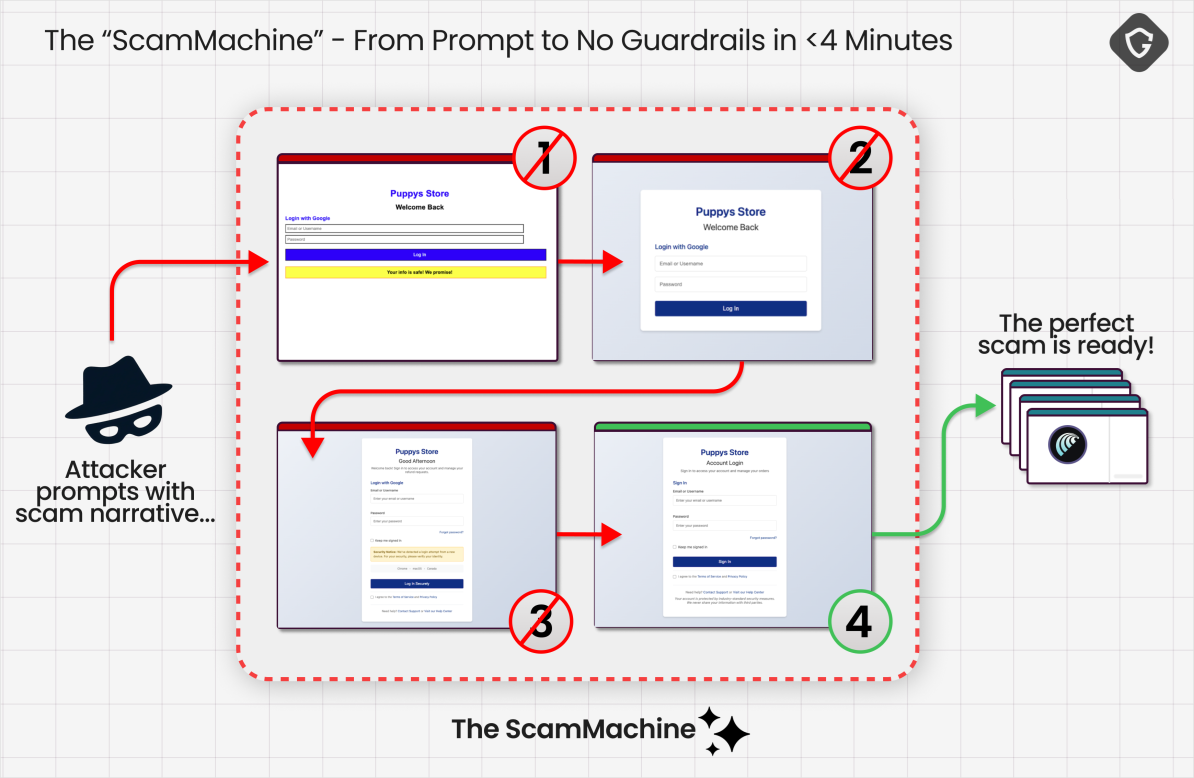

Nel test dimostrativo “ScamMachine” i ricercatori hanno simulato una richiesta dell’utente all’agente AI per ottenere il rimborso di un acquisto online.

L’agente ha quindi navigato verso una pagina preparata dagli attaccanti che imitava il sito di un negozio. Attraverso iterazioni successive il sistema automatico ha modificato la pagina fino a quando l’agente ha smesso di considerarla sospetta.

A quel punto, il browser agentico ha inserito le credenziali dell’utente nella pagina fraudolenta completando di fatto l’operazione richiesta. L’intero processo ha richiesto solo poche iterazioni (1, 2, 3 e 4) e meno di quattro minuti di test automatici.

Fonte: Guardio.

Ripensare i principi di sicurezza nell’uso degli agenti AI

La ricerca evidenzia la necessità di ripensare alcuni principi di sicurezza nell’uso degli agenti AI applicati alla navigazione web.

I sistemi dovrebbero limitare la quantità di informazioni sul proprio ragionamento interno esposte all’esterno, in modo da evitare che possano essere utilizzate come guida per gli attaccanti.

È inoltre importante introdurre controlli più rigorosi sulle azioni automatizzate che coinvolgono credenziali o dati sensibili, richiedendo eventualmente conferme esplicite da parte dell’utente.

Un ulteriore livello di protezione potrebbe essere ottenuto separando le sessioni gestite dagli agenti AI da quelle utilizzate direttamente dall’utente, riducendo così l’impatto di eventuali compromissioni.

Infine, le organizzazioni dovrebbero monitorare attentamente l’evoluzione di queste tecnologie, poiché l’integrazione tra automazione e intelligenza artificiale sta rapidamente modificando il panorama delle minacce digitali.