L’integrazione pervasiva dei sistemi di intelligenza artificiale generativa (GenAI) nei flussi operativi aziendali ha determinato un mutamento epistemologico nella gestione della sicurezza informatica.

Mentre l’utilità dei Large Language Models (LLM) è ormai consolidata, la rapidità con cui vengono dispiegati ha ampiamente superato la formalizzazione di framework di controllo e architetture di difesa standardizzate.

Questo scenario riflette l’evoluzione storica della sicurezza web: i Web Application Firewall (WAF) sono nati per contrastare le minacce a livello applicativo, come quelle elencate nell’OWASP Top 10, che i firewall di rete ignoravano.

Allo stesso modo, l’era dell’intelligenza artificiale generativa richiede una nuova astrazione difensiva.

I vettori di attacco semantici, come la prompt injection e il jailbreaking (leggasi l’OWASP Top 10 for Large Language Model Applications), eludono intrinsecamente i tradizionali meccanismi di protezione sintattica, rendendo necessario l’uso di un Generative Application Firewall (GAF).

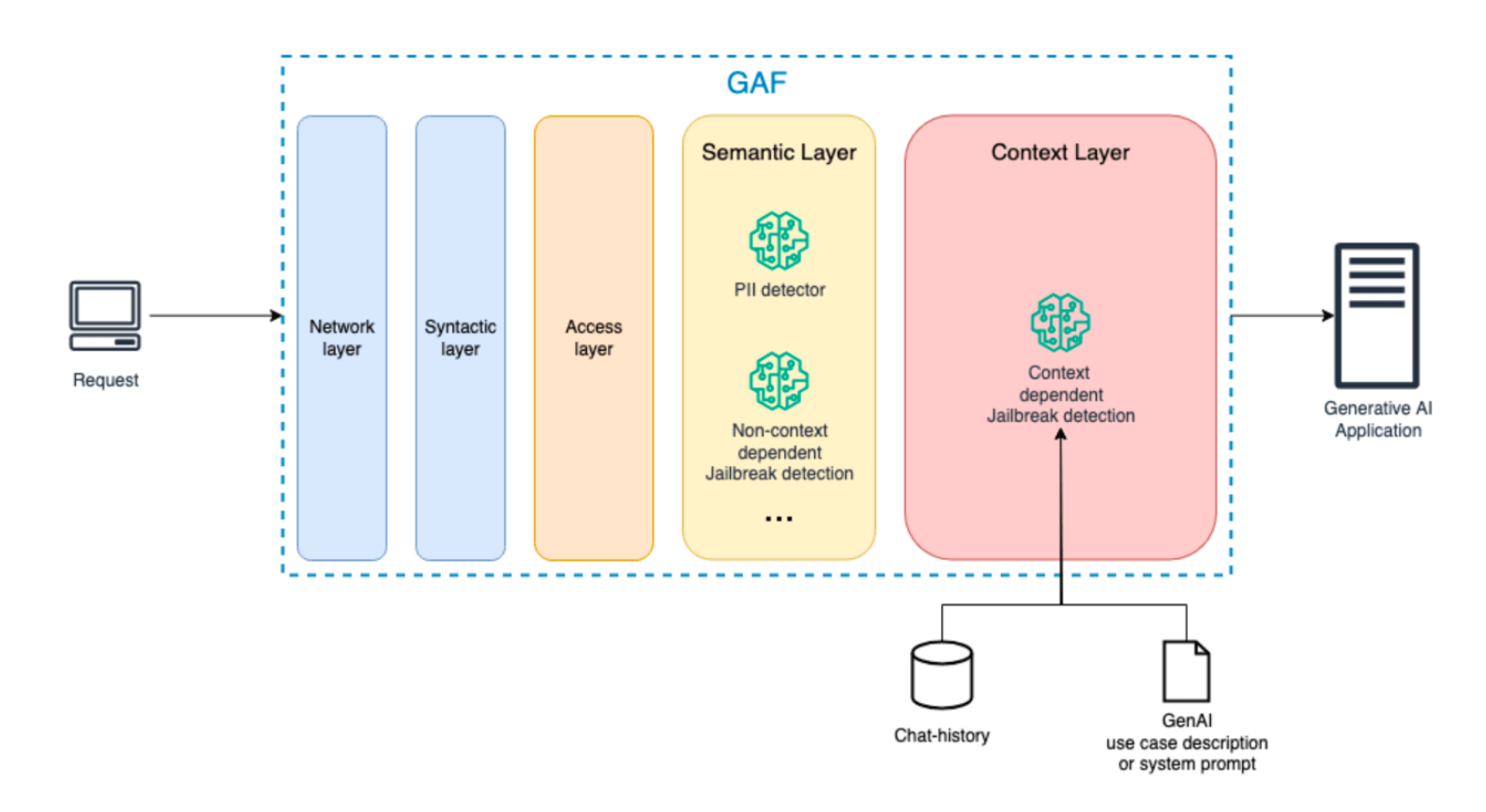

Il GAF si propone come il nesso di orchestrazione centralizzato per la protezione delle applicazioni LLM e degli agenti autonomi, agendo come un livello di difesa dedicato che va oltre i confini dei firewall convenzionali.

Ecco l’architettura stratificata del GAF, il suo modello di minaccia e come implementare un sistema di valutazione standardizzato per le aziende.

Indice degli argomenti

Analisi del fabbisogno: limiti delle difese tradizionali e “semantic

gap”

La rapida diffusione dei sistemi di intelligenza artificiale generativa negli ambienti produttivi ha reso necessario sviluppare framework di sicurezza adeguati.

La velocità di implementazione ha superato lo sviluppo di terminologie condivise, framework e modelli architetturali per la sicurezza e il controllo.

La sicurezza stratificata convenzionale (livelli 3-7 dello stack OSI) non è strutturalmente adeguata a mitigare i rischi intrinseci dei modelli probabilistici. L’efficacia dei firewall di rete (livelli 3 e 4) è annullata dal fatto che le minacce semantiche viaggiano all’interno di pacchetti HTTP formalmente corretti, utilizzando porte e protocolli standard che non presentano anomalie strutturali.

Parallelamente, i WAF tradizionali, progettati per il pattern matching deterministico contro vulnerabilità come SQL injection o XSS, non sono in grado di rilevare la manipolazione conversazionale.

Il “Semantic Gap” definisce la divergenza tra la validità sintattica di un input e la sua interpretazione dannosa.

Gli attacchi multi-turn, come la tecnica Echo Chamber, sfruttano la natura cumulativa del contesto per costruire attività malevole attraverso interazioni

apparentemente benigne e restano invisibili alle difese che analizzano le query in modo isolato.

Questa frammentazione delle difese richiede una transizione verso un sistema di protezione basato sulla comprensione del significato, centralizzato in un framework GAF in grado di colmare il divario tra la sicurezza della rete e la logica dell’IA.

Definizione e architettura del Generative Application Firewall (GAF)

Il GAF, proposto nell’articolo di J. V. Farreny ed altri, si configura come il punto di applicazione delle policy (centralized enforcement point) posizionato strategicamente tra l’utente e lo stack applicativo GenAI.

A differenza delle soluzioni isolate già presenti sul mercato, il GAF agisce come un orchestratore integrato di Prompt Guards, Guardrails e AI Gateways, fornendo una difesa unificata che non sostituisce, ma coordina le tecnologie esistenti.

Il GAF non solo media i prompt degli utenti, ma anche le chiamate agli strumenti (tool calls) avviate dagli agenti e i relativi output, mitigando i rischi di iniezione indiretta e di avvelenamento dei dati.

I cinque livelli di sicurezza del GAF

Il principio fondamentale del Generative Application Firewall (GAF) è che la protezione delle interfacce in linguaggio naturale richiede una protezione su diversi livelli interdipendenti.

Questo approccio a livelli è un’applicazione del principio Defense in Depth (difesa in profondità), un concetto di sicurezza consolidato che ora viene adattato agli agenti LLM.

Ogni livello affronta una classe distinta di rischi e solo se combinati tra loro forniscono una copertura completa.

I 5 strati dell’architettura del GAF

L’architettura del GAF suddivide le funzioni in cinque strati:

- Network Layer: gestisce il filtraggio IP, il rate limiting (a livello di richieste e token) e la mitigazione degli attacchi volumetrici e semantici (prompt flooding).

- Access Layer: governa l’autenticazione e l’autorizzazione granulare tramite Role-Based Access Control (RBAC), limitando l’accesso degli agenti a strumenti e basi di conoscenza specifici.

- Syntactic Layer: funge da punto di controllo per le minacce basate sulla codifica. Valida gli schemi di input/output e rileva le sequenze di escape e i token offuscati che potrebbero colpire gli interpreti di codice, a prescindere dal loro significato semantico.

- Semantic Layer: analizza l’intento in scenari single-turn. Identifica i tentativi di jailbreak noti (DAN, DEV mode, Best-of-N) e previene l’esfiltrazione dei dati personali identificabili (PII) basandosi sul significato intrinseco del prompt.

- Context Layer: monitora l’evoluzione longitudinale del dialogo. Rileva le strategie incrementali, come il crescendo, analizza il comportamento degli agenti e applica limiti di esfiltrazione cumulativi su più turni conversazionali.

Tabella 1: Riepilogo dei livelli di sicurezza GAF e delle capacità di rilevamento degli attacchi

| Layer Name | Attacchi Non-GenAI | Attacchi GenAI |

| Network Layer | Attacchi DDoS, minacce IP-based, attacchi TLS/SSL, accessinon autorizzati. | Prompt flooding |

| Access Layer | Session hijacking, privilege escalation, uso improprio delle funzionalità sensibili. | AI Agent tool access manipulation |

| Syntactic Layer | SQL injection, XSS, web application vulnerabilities | Prompt encodings and obfuscations |

| Semantic Layer | Context independent GenAI attacks like DAN, DEV mode, Best-of-N jailbreak | |

| Context Layer | Context dependent attacks like Crescendo attacks, Echo Chamber techniques, multi-turn jailbreaks. |

Questa struttura riflette ciò che sono realmente le applicazioni generative: non solo punti terminali che ricevono richieste, ma sistemi interattivi in cui l’intento si evolve attraverso i turni e le azioni possono propagarsi attraverso gli strumenti.

Proposta di estensione del modello OSI: il layer 8 (semantico)

Data la natura probabilistica dell’interazione con gli LLM, i modelli di astrazione

deterministici si rivelano incompleti.

Si propone, pertanto, l’introduzione del livello 8 (Semantic Layer) come estensione del livello applicativo.

Mentre il layer 7 si occupa della sintassi del protocollo, il layer 8 si occupa della frontiera interpretativa ovvero della trasformazione di istruzioni non strutturate in rappresentazioni azionabili e della mediazione dell’intento.

In coerenza con lo standard X.200, la Protocol Data Unit (PDU) rimane il dato, sottolineando che il fallimento a questo livello è dovuto alla manipolazione del significato e non agli errori di sintassi.

Tabella 2: Il modello OSI con il Semantic Layer proposto (L8):

| Layer | Nome | PDU | Funzione nel contesto GenAI |

| L8 | Semantic | Data | Interpretazione intenti e inferenza probabilistica |

| L7 | Application | Data | Protocolli (HTTP, WebSockets, gRPC) |

| L6 | Presentation | Data | Formattazione e codifica (Syntactic Choke Point) |

| L5 | Session | Data | Gestione persistenza e contesto conversazionale |

| L4 | Transport | Segment | Trasferimento dati affidabile (TCP) |

| L3 | Network | Packet | Routing e indirizzamento (IP) |

| L2 | Data Link | Frame | Impacchettamento dei dati |

| L1 | Physical | Bit, Symbol | Codifica e decodifica |

Modello delle minacce e confini di fiducia (Threat Model)

Un’implementazione rigorosa del GAF richiede la mappatura sistematica degli asset e degli avversari operanti nel dominio semantico:

- identificazione degli asset: include non solo le conoscenze di base (RAG) e i dati PII, ma anche le capacità operative degli agenti (tool/actions), le chiavi API e i piani di esecuzione degli agenti stessi;

- classificazione degli avversari: oltre agli attori esterni (jailbreaking) e agli insider malevoli, il modello deve considerare i Content Supply-Chain Adversaries, che avvelenano i contesti recuperati, e le minacce di Indirect Prompt Injection veicolate tramite output di strumenti o dati di terze parti;

- confini di fiducia (Trust Boundaries): il GAF opera come mediatore bidirezionale tra l’utente e il backend, tra l’applicazione e il provider LLM, e tra l’agente e le sandbox di esecuzione degli strumenti.

Analisi comparativa: GAF vs. WAF

Il Generative Application Firewall (GAF) rappresenta una categoria di difesa distinta e complementare al WAF e presenta diverse peculiarità operative sostanziali:

- Comprensione del linguaggio: il WAF utilizza il pattern matching statico, mentre il GAF applica l’inferenza semantica per rilevare manipolazioni linguistiche che non presentano firme esplicite.

- Gestione del contesto: mentre il WAF è tipicamente stateless, il GAF mantiene una memoria di sessione per correlare gli eventi attraverso più turni.

- Protocolli e streaming: il GAF è progettato per ispezionare i flussi in tempo reale (WebSockets, gRPC, SSE) e per monitorare i token durante la loro generazione.

- Azioni granulari: oltre alle decisioni binarie (Allow/Block), il GAF supporta il Redact (mascheramento selettivo dei token), l’Alert e il Redirect (soft guardrail verso flussi di fallback sicuri), garantendo la continuità operativa senza compromettere la sicurezza.

Performance operativa, rating e percorso di maturità

L’efficacia del GAF dipende dal bilanciamento tra il rigore della sicurezza e la latenza del sistema.

Il ciclo operativo si articola in 4 fasi:

- Admission: valutare l’identità/sessione, i limiti di velocità e le protezioni sintattiche di base prima di richiamare il modello o gli strumenti, e applicare le autorizzazioni/divieti di richiamo degli strumenti e gli ambiti.

- Generation: inoltrare le richieste consentite con hook di streaming; accumulare segnali a livello di token; monitorare i flussi di output degli strumenti.

- Intervention: in base ai trigger delle policy, è possibile redigere in modo selettivo i token o gli output degli strumenti, reindirizzare a fallback sicuri o terminare il flusso con una chiusura ben formata.

- Post-action: emettere log/metriche strutturate e aggiornare lo stato longitudinale per i cicli futuri, registrare la telemetria delle chiamate degli agenti/strumenti per l’analisi longitudinale.

Le azioni politiche granulari

In questo ciclo, GAF supporta azioni politiche granulari, quali: Block (rifiuto di una richiesta/chiamata di strumento o interruzione di uno stream), Redact (mascheramento degli span nel modello o nell’output dello strumento), Redirect (protezione soft verso una risposta sicura o un flusso di lavoro di fallback) e Alert (registrazione/notifica senza blocco), al fine di consentire un’applicazione sensibile al contesto e granulare.

Per misurare l’impatto delle prestazioni di GAF, definiamo la latenza aggiuntiva come segue: Δ= p95(t with GAF ). – p95(t baseline ), dove t indica la latenza end-to-end osservata per una singola richiesta.

In particolare, t si riferisce al tempo impiegato per l’impostazione della richiesta,

ovvero dal momento in cui l’utente invia la richiesta fino all’inizio dell’output dell’LLM.

Sistema di rating

Ispirato al modello Open Data a 5 stelle di Tim Berners-Lee, questo framework introduce un sistema di valutazione a 5 stelle per le implementazioni GAF.

La valutazione corrisponde direttamente ai cinque livelli di sicurezza rappresentati nella Tabella 1: ogni stella rappresenta la copertura completa di un livello, dai controlli di rete di base (1 stella) ai livelli di accesso, sintattico e semantico, fino alla protezione completa sensibile al contesto (5 stelle).

Questa struttura cumulativa riflette il principio della defense-in-depth: per ottenere le valutazioni più alte, è necessario che siano presenti tutte le protezioni dei livelli inferiori.

Le organizzazioni possono utilizzare questo sistema per valutare la propria postura attuale, individuare le lacune e definire un percorso di crescita verso una sicurezza completa basata sull’intelligenza artificiale generativa.

| Stelle | Layer | Protezione | Controlli | Attacchi |

| ★ | Network | Basic network- level filtering and access control | IP filtering, Rate and Token level Limiting, DDoS protection | DoS, IP-based threats, Prompt flooding, TLS/SSL attacks |

| ★ ★ | Access | User and Agent authentication and authorization | Role-based access control, Session management, Policy enforcement | Session hijacking, Privilege escalation, Tool access manipulation |

| ★ ★ ★ | Syntactic | Syntactic analysis of inputs and outputs | Request/response filtering, Protocol validation, Format checks | SQL injection, XSS, Web vulnerabilities, Streaming protocol violations, Prompt encodings |

| ★ ★ ★ ★ | Semantic | GenAI non- context dependent attacks | Prompt and context analysis, Semantic understanding, Jailbreak detection | DAN, DEV mode, Best-of-N jailbreak, Data exfiltration, PII, Prompt injection |

| ★ ★ ★ ★★ | Context | GenAI context dependent attacks | Multi-turn analysis, Conversation tracking, Semantic understanding | Echo-Chamber, Crescendo |

Per raggiungere il punteggio massimo, è necessario utilizzare una suite di test

riproducibile e un corpus di red teaming rappresentativo che includa attacchi sia a turno singolo che a più turni e che verifichi costantemente i tassi di precisione/ricordo e la latenza p95 sotto carico avversario.

Una difesa unificata per mitigare i rischi

Il Generative Application Firewall si presenta come un pillar indispensabile per la transizione verso un’IA responsabile. Attraverso l’orchestrazione di difese frammentate in un perimetro semantico coerente, l’adozione del modello a cinque strati e l’integrazione del Layer 8 OSI, le organizzazioni possono mitigare in modo sistematico i rischi emergenti derivanti dalle minacce semantiche e conversazionali negli agenti e nelle applicazioni GenAI.

In un ecosistema dominato da interfacce probabilistiche, la capacità di monitorare l’intento e il contesto non è più un’opzione tecnica, ma un imperativo strategico per garantire la resilienza dei sistemi intelligenti.

Perseguire elevati rating di maturità GAF è una condizione necessaria per stabilire standard di eccellenza nella protezione dei confini dell’intelligenza artificiale.

In sintesi, Il GAF orchestra gli strumenti esistenti in una difesa unificata, sfruttando le conoscenze della comunità per mitigare i rischi emergenti.