Una ricerca pubblicata dall’azienda di cyber security Bitdefender mette in luce l’evoluzione di APT36, gruppo pakistano noto anche con il nome di Transparent Tribe, che ha adottato un modello di sviluppo basato sulle intelligenze artificiali con cui produrre un’attività massiccia di malware scritti in linguaggi di nicchia come Zim, Zig e Crystal. Questo modello è stato battezzato vibeware.

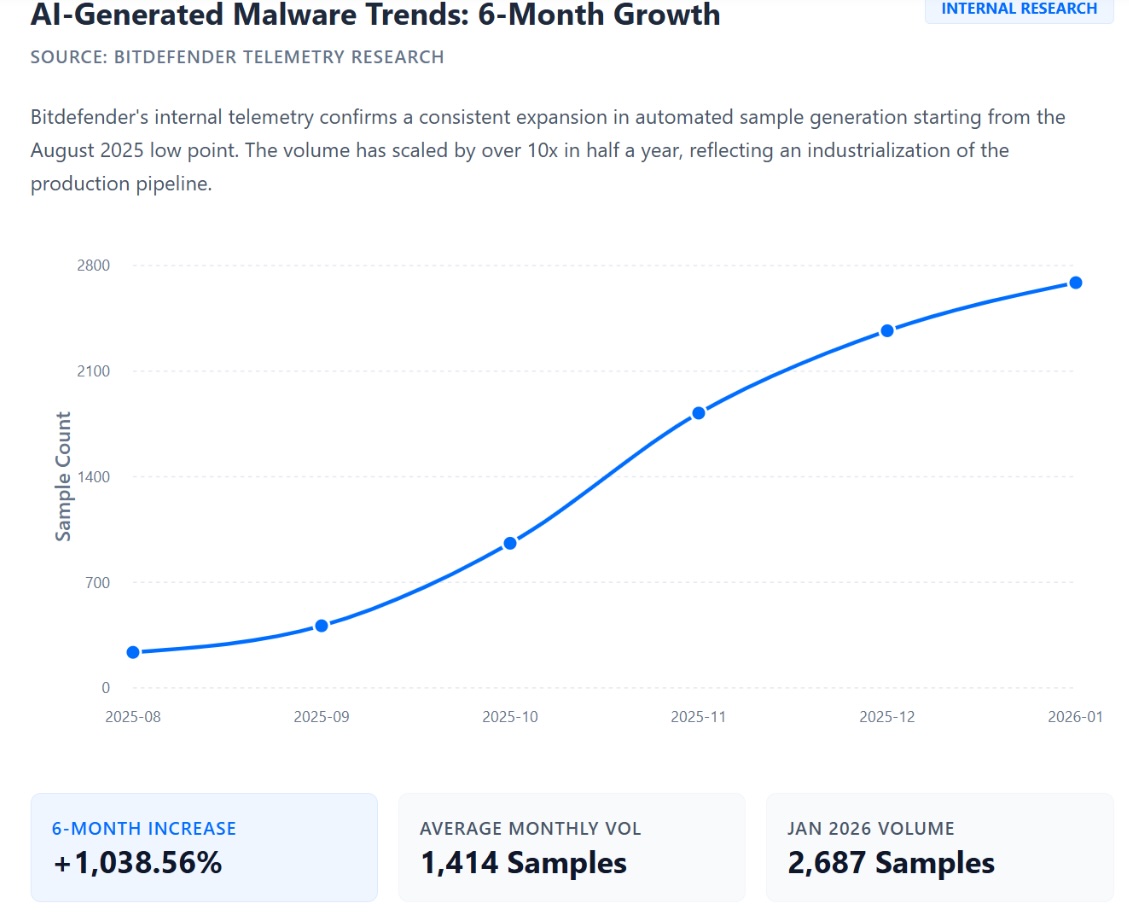

Il grafico sotto mostra il numero di campioni di malware generati dalle IA identificati da Bitdefender nel corso del semestre scorso.

Malware che non sono riconducibili solo ad APT36 ma che suggeriscono quanto la produzione seriale di minacce stia diventando rilevante nel panorama della cyber security.

L’obiettivo principale è saturare i sistemi di difesa attraverso un elevato volume di varianti, rendendone difficile il rilevamento.

Gli aggressori sfruttano servizi cloud legittimi come Slack, Discord e Google Sheets per le attività di comando e controllo il cui traffico di rete si mimetizza con quello autorizzato.

Nonostante l’automazione nella scrittura del codice, le operazioni di spionaggio rimangono mirate e dirette manualmente dagli operatori umani.

Per comprendere appieno il fenomeno abbiamo rivolto delle domande a Martin Zugec, Technical Solutions Director di Bitdefender.

Indice degli argomenti

Il cambio di paradigma: dalla sofisticatezza al vibeware

La strategia operativa di APT36 passa dall’uso di framework commerciali standard a un modello di sviluppo guidato dalle AI, ossia il vibeware identificato da Bitdefender.

APT36 lascia la via vecchia, quella della sofisticatezza, per imboccare una nuova via, quella dell’industrializzazione della produzione di minacce “usa e getta” di minore qualità ma non per questo di minore efficacia.

Il cuore di questa strategia è il Distributed Denial of Detection (DDoD): l’obiettivo non è superare le difese con exploit zero-day, ma esaurire le capacità analitiche dei difensori attraverso un volume massiccio di varianti generate quotidianamente.

In parole spicce, la creazione di software malevolo industriale non punta alla raffinatezza tecnica ma mira a sfiancare le capacità di difesa degli obiettivi.

DDoD e linguaggi di nicchia

Il ricorso ai Large Language Model (LLM) mette gli attaccanti in condizione di abbattere le barriere di competenza e di adottare linguaggi di programmazione di nicchia.

Non di meno, gli stessi LLM si prestano al riconfezionamento di codice esistente che APT36 usa per trasformare le logiche di backdoor consolidate in nuovi eseguibili che, prodotti in diverse varianti, bersagliano l’infrastruttura target.

La maggior parte dei motori dei software antivirus e delle soluzioni Endpoint Detection and Response (EDR) è tarata su pattern comportamentali di linguaggi comuni (tra i quali .NET, C++, C#) e il ricorso a linguaggi come Crystal o Nim bypassa l’efficacia di tali sistemi di difesa perché mancano firme consolidate e runtime noti.

Tutto ciò apre le porte al Distributed Denial of Detection (DDoD) che fa leva sulla capacità degli attaccanti di creare una quantità di minacce di bassa gravità ma sempre diverse tra loro.

Se una variante viene scoperta e bloccata, l’attaccante ne ha già pronte altre decine che utilizzano linguaggi o protocolli diversi per mantenere l’accesso al target e saturare le capacità dei sistemi di rilevamento.

Il DDoD sta alla telemetrie dei rilevamenti delle minacce come il DDoS sta alla capacità di un server di gestire le chiamate.

In un simile contesto, è sensato approfondire il tema delle strategie difensive per comprendere in che modo il DDoD ridefinisce le priorità dei team di sicurezza che ancora oggi si affidano soprattutto a motori di scansione basati su firme e file binari.

Martin Zugec spiega che: “È importante chiarire che il settore della sicurezza informatica ha superato da molti anni la dipendenza primaria dalle firme. Le moderne soluzioni di sicurezza per endpoint adottano infatti un approccio multilivello basato sull’analisi comportamentale, in cui le firme svolgono soprattutto una funzione di ottimizzazione delle prestazioni, permettendo di individuare rapidamente le minacce già note.

Tuttavia, l’ascesa del vibeware introduce una sfida tecnica diversa. I moduli di rilevamento comportamentale sono addestrati su set di dati specifici, solitamente incentrati sui linguaggi di programmazione più comuni come C++ o C#.

Quando gli hacker utilizzano l’AI per trasferire rapidamente malware in linguaggi di nicchia come Nim, Zig o Crystal, mettono alla prova l’efficacia e la capacità di questi motori comportamentali. Poiché questi sistemi sono spesso addestrati su dataset legati ai linguaggi più diffusi, un file binario scritto in linguaggi meno comuni può risultare più difficile da profilare in termini di intenzione e comportamento, a seconda di come è stato progettato il prodotto di sicurezza.

Per i team della sicurezza, la priorità diventa quindi assicurare che gli strumenti non siano soltanto indipendenti dal linguaggio utilizzato, ma anche capaci di riconoscere i risultati funzionali di un programma, a prescindere dall’ambiente di runtime in cui opera”.

Come sottolinea Martin Zugec, le organizzazioni che basano la cybersecurity su software che seguono la logica delle firme corrono su binari morti.

L’abuso dei Living Off Trusted Services (LOTS)

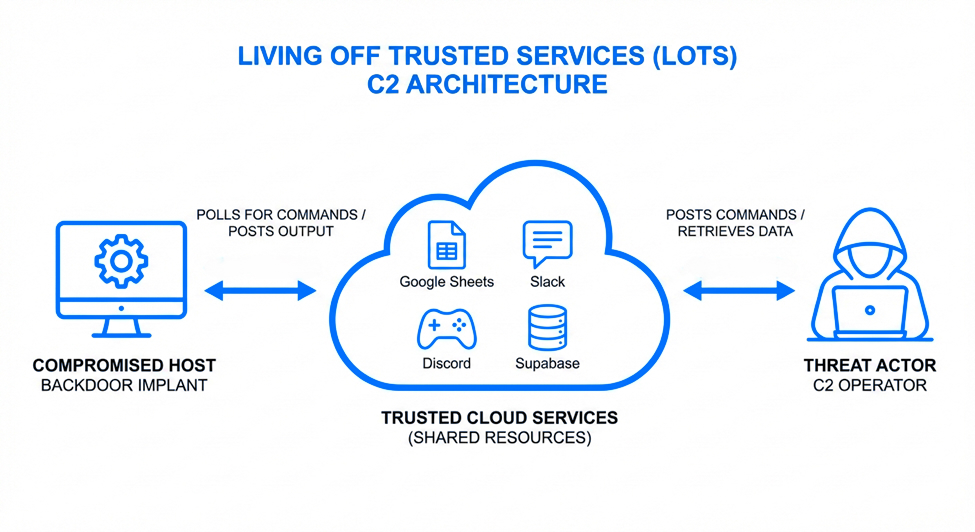

Un pilastro fondamentale del modello vibeware è l’integrazione di servizi cloud legittimi per il Command & Control (C&C) e l’esfiltrazione dei dati.

Questa tecnica, denominata Living Off Trusted Services (LOTS), rende il traffico malevolo quasi indistinguibile da quello generato dalle normali attività aziendali.

Gli aggressori sfruttano le API pubbliche e gli SDK di piattaforme come Slack, Discord, Google Sheets, Supabase e Firebase e, giacché queste piattaforme sono ampiamente documentate, gli LLM sono in grado di generare codice di integrazione estremamente stabile e funzionale, permettendo agli attaccanti di operare senza dover gestire un’infrastruttura C&C proprietaria e sospetta.

La natura ibrida della minaccia

L’automazione della produzione del malware non coincide con l’automazione dell’attacco. Mentre il vibeware viene generato massivamente dalle IA, le operazioni di hacking e del post-compromissione sono svolte dall’elemento umano.

Dopo l’accesso iniziale operato spesso tramite email di phishing con esche PDF sofisticate, gli operatori si connettono interattivamente per muoversi lateralmente e profilare i target tramite social network professionali.

Si tratta di un modello ibrido che combina la velocità di produzione del software con l’adattabilità dell’intelligenza umana.

È opportuno stabilire quanto è determinante l’efficacia dell’intervento umano per compensare la mediocrità del software prodotto dalle IA: “L’intervento umano resta un elemento centrale del processo. Nel corso della nostra analisi di questa campagna, abbiamo rilevato decine di campioni in continuo mutamento, probabilmente affinati da un operatore umano che sfruttava l’IA come strumento di progettazione”, illustra Martin Zugec che continua la propria analisi approfondendo una differenza sostanziale.

Infatti, spiega Zugec, “Esiste una differenza fondamentale tra l’utilizzo dell’IA per sviluppare software legittimo e il suo impiego nella creazione di malware. Per il software legittimo, l’obiettivo è produrre applicazioni complesse e ricche di funzionalità. Nel caso del malware, invece, la complessità diventa spesso un limite, perché aumenta la superficie di rilevamento. Gli hacker professionisti sanno che il malware deve essere semplice, unico e difficile da individuare.

Sebbene alcuni ritengano che l’IA possa un giorno generare software complessi in autonomia, nel caso del malware tali risultati si rivelano spesso controproducenti. L’operatore umano, in questo caso il criminal hacker, agisce come filtro, controlla che l’output generato resti semplice e funzionante, senza elementi superflui, in modo da non attivare sistemi avanzati che monitorano comportamenti sospetti”.

Le strategie di difesa e le raccomandazioni di Bitdefender

Partiamo dall’abuso di servizi cloud come Slack o Google Sheets che rende il comando e controllo quasi invisibile ai firewall tradizionali.

Per isolare il traffico LOTS (Living Off Trusted Services) occorre un’ottica di analisi opportuna.

Infatti, come spiega Martin Zugec “Il monitoraggio del traffico LOTS richiede uno spostamento dall’analisi del perimetro di rete all’osservazione dell’endpoint. I firewall tradizionali risultano spesso insufficienti, perché non è praticabile bloccare l’infrastruttura cloud legittima su cui fanno affidamento le aziende moderne. Per affrontare questa sfida, le aziende devono concentrarsi sui colli di bottiglia comportamentali. Invece di chiedersi se un dominio sia ‘sicuro’, è fondamentale capire perché un processo specifico interagisce con quel dominio.

Per esempio, un team di sicurezza dovrebbe potere identificare il motivo per cui un file binario non standard comunica con un webhook di Discord o con un’API di Google Sheets”, conclude l’esperto.

Più in generale, per affrontare al meglio questo tipo di minacce, gli EDR devono concentrarsi sul comportamento del processo e ciò è relativamente più semplice laddove vige una riduzione dinamica della superficie di attacco e laddove vigono soluzioni Managed Detection & Response (MDR) capaci di produrre attriti durante le fasi di movimento laterale, forzando così gli attaccanti a rivelarsi.

Conclusioni

Il caso APT36 dimostra che le IA stanno democratizzando la creazione di malware di massa.

Nonostante la scarsa qualità del codice, la capacità di generare varianti infinite e l’abuso sistematico di servizi cloud fidati rappresentano un’evoluzione delle capacità degli attaccanti.

La difesa deve evolvere verso un’analisi olistica del comportamento, ignorando la dozzinale superficialità del codice per concentrarsi sulle azioni finali dei criminal hacker.